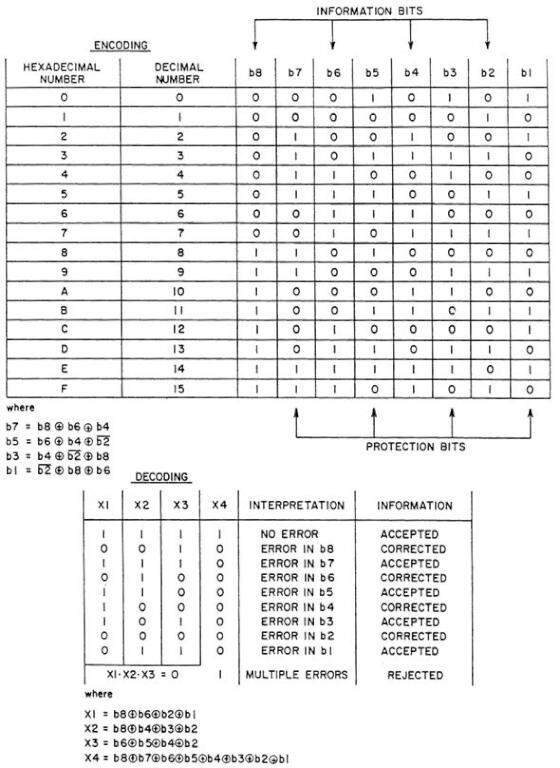

No se puede corregir con un solo bit de paridad. Esto se debe a que un error de bit en cualquier posición crea exactamente la misma información que una mala paridad. Los bits defectuosos se pueden reconocer cuando se integran más bits en el mensaje y se pueden establecer de manera que diferentes bits de error produzcan diferentes resultados de error. En un mensaje de 7 bits, pueden ocurrir 7 errores de un solo bit, por lo que los 3 bits de control de errores pueden identificar no solo que ocurrió un error, sino también el bit que causó el error. Por lo tanto, el código Hamming se introdujo como un método de control de errores para permitir la corrección de errores de un solo bit.

código de tarareo

El código Hamming detecta errores dobles, pero solo se puede corregir uno. Este método de corrección de errores es mejor para situaciones en las que es más probable que se produzcan errores al azar en lugar de esporádicamente. Richard Hamming, un filósofo de Bell Telephone Laboratories en la década de 1940, desarrolló el método de corrección de errores del Código Hamming en 1949.

La distancia de Hamming entre dos cadenas de bits es el número de bits que se deben cambiar para convertir una a la otra. Si la distancia de Hamming es 1, un error de un solo bit dará como resultado otra cadena válida. Esto significa que los errores no se pueden detectar. Con una distancia de Hamming de 2, cambiar 1 bit da como resultado una cadena no válida, que puede detectarse como un error. Cambiar un bit más podría dar como resultado una cadena válida diferente. En otras palabras, no puede saber qué bit estaba mal, por lo que puede detectar el error, pero no puede solucionarlo. Distancia de Hamming igual a 3. Cambiar un bit aleja un bit del error original, pero dos bits de cualquier otra cadena válida. Esto significa que si tiene un error de 1 bit, puede averiguar qué bit tiene el error, pero si tiene errores de 2 bits, es como 1 bit en la dirección opuesta.

código ASCII

El Código estándar estadounidense para el intercambio de información (ASCII) es un sistema de codificación de caracteres basado en el alfabeto inglés. Los códigos ASCII representan texto en computadoras, equipos de comunicación y otros dispositivos que usan texto. La mayoría de los sistemas de codificación de caracteres modernos se basan en ASCII. También define un código de 128 caracteres con 33 caracteres no imprimibles y 95 caracteres imprimibles.

Código EBCDIC

El código de información decimal codificado en binario extendido (EBCDIC) es un conjunto de caracteres de 8 bits desarrollado por International Business Machines (IBM). Se utilizó en la mayoría de las computadoras fabricadas por IBM antes de 1981. Hay 256 caracteres posibles y los caracteres se clasifican como alfabetos, números y caracteres especiales. Casi todos los caracteres no alfanuméricos están fuera del rango de BCD. Las páginas de códigos EBCDIC tienen cuatro bloques principales. 0000 0000 a 0011 1111 están reservados para caracteres de control. 0100 0000 a 0111 1111 son para puntuación. Las letras minúsculas van del 1000 0000 al 1011 1111, las letras mayúsculas y los números van del 1100 0000 al 1111 1111.